Tabellarische Quellen zwischen Geschichtswissenschaften und Digital Humanities – ein Transkribathon

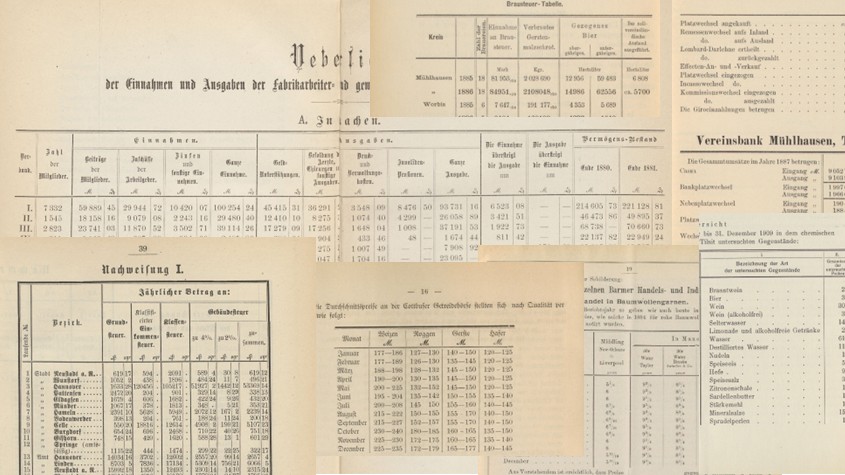

Die tabellarische Strukturierung bzw. Visualisierung von Informationen zählt seit jeher zu den Standardmodi der Wissensvermittlung und -speicherung. Ungeachtet aller Dynamik auf den Forschungsfeldern von Computer Vision und Pattern Recognition stellen jedoch die automatische Erkennung und Extraktion der Inhalte historischer Tabellen in ihrer schieren Vielfalt nach wie vor die verfügbaren proprietären wie quelloffenen Softwareangebote für Optical Character bzw. Handwritten Text Recognition (OCR/HTR) vor beträchtliche Herausforderungen.

Diesem Defizit steht insbesondere von Seiten der historisch orientierten Wirtschafts- und Sozialwissenschaften der Wunsch nach niedrigschwelligen Angeboten zur automatischen Tabellenextraktion gegenüber – ein Spannungsverhältnis, das angesichts des anhaltenden Aufschwungs der Kliometrie wie auch der zahlreichen aktuellen Projektaktivitäten zur Generierung und Analyse langer Zeitreihen zusehends schmerzhafter wird. Unter den angesprochenen Vorhaben ist beispielsweise das auf 18 Jahre angelegte Frankfurter Akademieprojekt Finanz- und Unternehmensforschung aus der Langfristperspektive: Erschließung historischer Bestände deutscher Finanzmarkt- und Unternehmensdaten (1871–2025) zu nennen und nicht zuletzt das von der Deutschen Forschungsgemeinschaft geförderte Vorhaben der Staatsbibliothek zu Berlin Regionale Wirtschaftsentwicklung in qualitativ-quantitativer Doppelperspektive zur Digitalisierung ihrer herausragenden Sammlung an Jahresberichten deutscher Handelskammern des ‚langen‘ 19. Jahrhunderts.

Um das Fundament zur Einlösung des vielfach angemahnten Desiderats eines generischen maschinellen Datenextraktionsinstruments (historischer) tabellarischer Quellen zu legen, entsteht gegenwärtig an der Professur für Digitale Geschichtswissenschaften der Universität Bamberg ein Benchmarking-Datenset gedruckter Tabellen aus der Zeit zwischen 1750 und 1990. Dieses aus Mitteln der NFDI4Memory geförderte Vorhaben möchte die kaum überschaubare Vielfalt der historischen Erscheinungsformen von Tabellen in ca. 10.000 Objekten abbilden und deren Strukturmerkmale mit Annotationen erfassen. Denn frei verfügbare qualitätsgesicherte Referenzdaten (Ground Truth) zum Training von Tabellenextraktionsmodellen sind bislang rar und zudem überwiegend aus modernen Vorlagen geschöpft.

Vor diesem Hintergrund zielt die in Kooperation mit der Professur für Digitale Geschichtswissenschaften der Otto-Friedrich-Universität Bamberg und NFDI4Memory organisierte hybride Veranstaltung, zu der wir herzlich ins Stabi Lab der Staatsbibliothek zu Berlin einladen, darauf, den Teilnehmenden zunächst in mehreren Impulsvorträgen einen Überblick der aktuellen Entwicklungen auf dem Feld der automatischen Extraktion historischer Tabelleninhalte zu geben. Anschließend sollen ausgewählte Tabellen gemeinsam intellektuell annotiert und so wertvolle Ground Truth-Daten für das Training künftiger Softwarelösungen gewonnen werden. Bring your own table: Die Teilnehmenden sind ausdrücklich eingeladen, eigene tabellarische Quellen mitzubringen, um diese gemeinsam zu transkribieren und zu annotieren.

Vorläufiges Programm

10.09.2026

| 09:45–10:00 Uhr | Ankommen und Begrüßung |

| Impulsvorträge | |

|---|---|

| 10:00–10:30 Uhr | Im Raster der Erkenntnis. Überlegungen zu einer Kulturgeschichte der Tabelle (Werner Scheltjens) |

| 10:30–11:00 Uhr | Aufbau und Bereitstellung eines Benchmark-Datensatzes historischer Tabellen (Sebastian Geschonke) |

| 11:00–11:30 Uhr | Zur digitalen Bereitstellung der DIW Wochenberichtsinhalte 1928 bis 1968 (Tobias Gebel, Frank Puppe) |

| 11:30–12:00 Uhr | tbc (NN) |

| 12:00–13:00 Uhr | Mittagspause |

| Annotieren und Transkribieren in der Praxis | |

| 13:00–17:30 Uhr | Gemeinsame Transkription ausgewählter Tabellen (mit Kaffeepausen): Bring Your Own Table |

| 17:30–18:00 Uhr | Abschlussdiskussion im Plenum |

© Stabi Berlin, Foto: Marcus Glahn Fotografie

© Stabi Berlin, Foto: Marcus Glahn Fotografie